一則新聞引發(fā)科技界與社會(huì)公眾的廣泛關(guān)注:美國(guó)民權(quán)組織ACLU的測(cè)試顯示,亞馬遜的人臉識(shí)別軟件Rekognition將28名美國(guó)國(guó)會(huì)議員的照片錯(cuò)誤地匹配到了警方罪犯數(shù)據(jù)庫中的面孔上,且被誤判的議員中,有色人種的比例顯著偏高。這一事件迅速將人工智能技術(shù),特別是人臉識(shí)別應(yīng)用的倫理、準(zhǔn)確性與公平性問題推至風(fēng)口浪尖。人們不禁要問:這究竟是前沿的‘人工智能’,還是暴露了其局限性的‘人工弱智’?而作為人工智能應(yīng)用軟件的開發(fā)者,我們又應(yīng)從這一事件中汲取哪些深刻的教訓(xùn)?

一、 事件剖析:技術(shù)失誤還是系統(tǒng)偏見?

亞馬遜的Rekognition軟件在此次測(cè)試中的表現(xiàn),絕非簡(jiǎn)單的‘程序bug’。其誤判呈現(xiàn)出兩個(gè)關(guān)鍵特征:

- 高錯(cuò)誤率:在測(cè)試的535位議員中,誤判28人,錯(cuò)誤率超過5%。對(duì)于關(guān)乎人身自由與名譽(yù)的執(zhí)法輔助工具而言,這一比率是難以接受的。

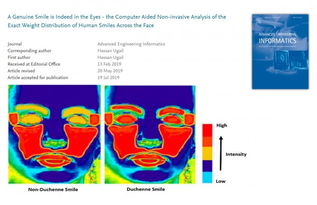

- 明顯的種族偏差:被誤判的議員中,近40%是有色人種,而美國(guó)國(guó)會(huì)中有色人種議員的比例僅為20%。這強(qiáng)烈暗示算法在訓(xùn)練數(shù)據(jù)或特征提取上可能存在系統(tǒng)性偏見,導(dǎo)致對(duì)深色皮膚人種的識(shí)別準(zhǔn)確率顯著較低。

這揭示了一個(gè)核心問題:當(dāng)前許多人工智能應(yīng)用,尤其是基于機(jī)器學(xué)習(xí)模型的應(yīng)用,其‘智能’高度依賴于訓(xùn)練數(shù)據(jù)的質(zhì)量、數(shù)量和代表性。如果訓(xùn)練數(shù)據(jù)本身包含社會(huì)既有偏見(如警方數(shù)據(jù)庫的歷史逮捕記錄可能反映執(zhí)法中的種族不平等),或某一群體(如深膚色人群)的數(shù)據(jù)樣本不足,算法就會(huì)‘學(xué)習(xí)’并放大這些偏見,導(dǎo)致輸出結(jié)果不公。這并非算法本身具有‘意識(shí)’,而是其設(shè)計(jì)、訓(xùn)練和部署環(huán)節(jié)中‘人’的因素出現(xiàn)了偏差。

二、 人工智能還是人工弱智?一個(gè)片面的二分法

將此次事件簡(jiǎn)單定性為‘人工弱智’,是對(duì)復(fù)雜技術(shù)問題的過度簡(jiǎn)化。Rekognition在商品檢索、內(nèi)容管理、用戶驗(yàn)證等商業(yè)化場(chǎng)景中表現(xiàn)尚可,證明了其底層技術(shù)具備一定的‘智能’。問題在于,當(dāng)技術(shù)從受控的、相對(duì)簡(jiǎn)單的商業(yè)環(huán)境,貿(mào)然進(jìn)入高風(fēng)險(xiǎn)的、社會(huì)結(jié)構(gòu)復(fù)雜的公共安全與司法領(lǐng)域時(shí),其局限性、未經(jīng)驗(yàn)證的可靠性和潛在的倫理風(fēng)險(xiǎn)被急劇放大。

真正的‘弱智’,或許體現(xiàn)在技術(shù)應(yīng)用過程中的幾個(gè)‘人為’環(huán)節(jié):

- 對(duì)技術(shù)局限性的認(rèn)知不足:開發(fā)者或推廣者可能低估了算法在復(fù)雜現(xiàn)實(shí)場(chǎng)景(如低光照、不同角度、人口多樣性)下的表現(xiàn)差異。

- 倫理考量的缺失:在追求算法精度和效率的未能將公平性、可解釋性、問責(zé)制等倫理原則嵌入開發(fā)流程。

- 適用場(chǎng)景的誤判:將尚未準(zhǔn)備好應(yīng)對(duì)極端后果的技術(shù),輕率地應(yīng)用于可能對(duì)公民權(quán)利產(chǎn)生重大影響的領(lǐng)域。

因此,問題不在于技術(shù)是‘智能’還是‘弱智’,而在于我們?nèi)绾呜?fù)責(zé)任地開發(fā)、評(píng)估和部署它。

三、 人工智能應(yīng)用軟件開發(fā)的深刻啟示

這一爭(zhēng)議為所有AI應(yīng)用軟件開發(fā)者敲響了警鐘。未來的開發(fā)實(shí)踐必須超越單純的技術(shù)優(yōu)化,融入更全面的責(zé)任框架:

- 數(shù)據(jù)正義先行:必須將訓(xùn)練數(shù)據(jù)的審計(jì)作為開發(fā)的核心環(huán)節(jié)。確保數(shù)據(jù)集的規(guī)模、多樣性和質(zhì)量,主動(dòng)檢測(cè)并修正數(shù)據(jù)中可能存在的歷史與社會(huì)偏見。對(duì)于人臉識(shí)別這類技術(shù),必須包含足夠多元的種族、性別、年齡、光照條件等樣本。

- 構(gòu)建全面的評(píng)估體系:性能評(píng)估不能只看整體準(zhǔn)確率,必須進(jìn)行差異性分析,即針對(duì)不同人口統(tǒng)計(jì)學(xué)子群體(如不同種族、性別)分別評(píng)估算法的準(zhǔn)確率、誤報(bào)率和漏報(bào)率。任何在子群體間存在顯著性能差異的模型,在解決此問題前都不應(yīng)部署于高風(fēng)險(xiǎn)場(chǎng)景。

- 嵌入倫理設(shè)計(jì):將倫理考量從事后的‘補(bǔ)丁’轉(zhuǎn)變?yōu)槭虑暗摹O(shè)計(jì)規(guī)范’。這包括建立多學(xué)科的倫理審查委員會(huì),在算法中引入公平性約束,并開發(fā)使算法決策更可解釋的工具,讓‘黑箱’變得透明。

- 明確適用邊界與人類監(jiān)督:開發(fā)者有責(zé)任明確界定其技術(shù)的有效應(yīng)用場(chǎng)景和局限性。對(duì)于高風(fēng)險(xiǎn)應(yīng)用(如執(zhí)法、司法、雇傭),必須堅(jiān)持‘人類在環(huán)’原則,即算法結(jié)果僅能作為輔助參考,最終決策必須由經(jīng)過培訓(xùn)、并了解技術(shù)局限的人類官員審慎做出。

- 加強(qiáng)行業(yè)自律與外部監(jiān)管:技術(shù)公司需要建立更嚴(yán)格的內(nèi)部測(cè)試和審計(jì)標(biāo)準(zhǔn)。這一事件也凸顯了立法與監(jiān)管的必要性,需要建立關(guān)于AI系統(tǒng)準(zhǔn)確性、公平性測(cè)試及透明度的行業(yè)標(biāo)準(zhǔn)甚至法律法規(guī)。

###

亞馬遜人臉識(shí)別軟件的這次‘誤判’,與其說是人工智能的‘失敗’,不如說是對(duì)整個(gè)人工智能行業(yè)的一次嚴(yán)厲‘壓力測(cè)試’。它無情地暴露了在技術(shù)狂奔背后,我們?cè)跀?shù)據(jù)、倫理、評(píng)估和責(zé)任機(jī)制上的準(zhǔn)備不足。它提醒我們,人工智能應(yīng)用軟件的開發(fā),從來不是純粹的技術(shù)競(jìng)賽,而是一項(xiàng)深刻的社會(huì)技術(shù)工程。真正的‘智能’,不僅體現(xiàn)在算法的精妙上,更體現(xiàn)在開發(fā)者對(duì)技術(shù)社會(huì)影響的深刻理解、對(duì)潛在危害的主動(dòng)防范、以及對(duì)公平正義的不懈追求之中。唯有將責(zé)任與倫理置于與創(chuàng)新同等的核心地位,我們才能確保人工智能技術(shù)真正服務(wù)于人類社會(huì)的福祉,而非反之。從‘人工弱智’的爭(zhēng)議中學(xué)習(xí),正是走向更負(fù)責(zé)任、更可信賴的人工智能的必經(jīng)之路。